OpenClaw 初探:當 AI 不再只是聊天,而是開始「動手做事」

—小島視角|Uncle Lu(老呂) | February 8, 2025

過去兩年,生成式 AI 的主戰場幾乎都圍繞在「會不會說話」:誰的模型更聰明、誰的回覆更像人、誰的推理能力更強。

但在產業第一線,另一個問題正變得愈來愈清楚:

如果 AI 只會回答,不能行動,那它究竟離「真正的生產力工具」還有多遠?

這也正是為什麼最近像 OpenClaw 這類「可操作工具的 AI Agent」開始引起關注。

1. 從「會聊天」到「會做事」:AI 正在換賽道

從技術演進來看,ChatGPT 這一代模型主要解決的是「理解與生成語言」的問題;然而,在多數組織的實務場景中,真正消耗人力成本的,往往不是「不知道怎麼做」,而是:

- 需要開啟哪些系統

- 需要填寫哪些表單

- 需要在不同介面之間複製貼上資料

- 需要反覆執行哪些例行流程

這類工作在技術上並不困難,卻高度耗時,也難以避免人為疏失。

因此,像 OpenClaw 這類工具,關注的已不只是「更聰明的對話」,而是讓 AI 能夠實際操作軟體介面、執行流程,並完成一連串任務。

換言之,它的目標並非成為「更會說話的顧問」,而是更接近一個能實際動手做事的數位員工。

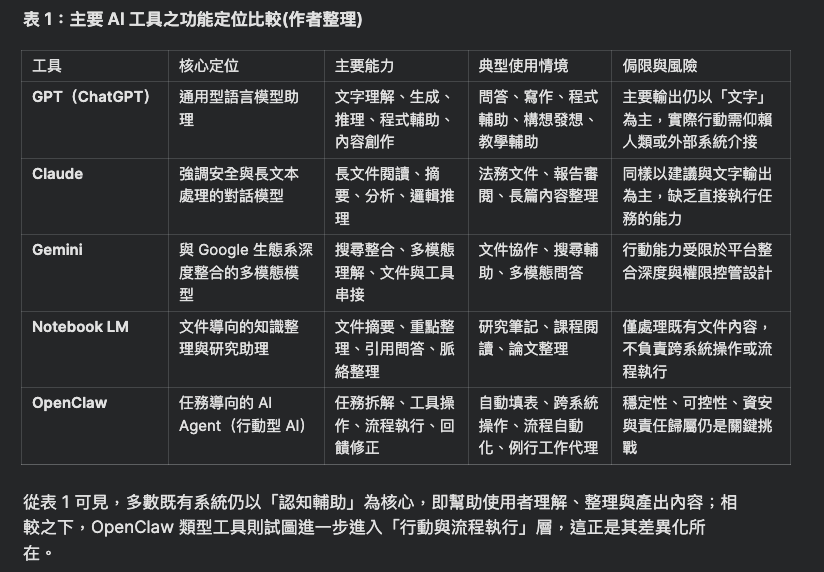

為了說明目前主流 AI 工具在功能定位上的差異,表 1 彙整了幾個常見系統的核心特性與應用情境。

2. 從資料科學角度看:這是一個「執行層」的突破

如果從系統架構的角度來看,傳統 LLM 大致停留在以下流程:

使用者 → 語言模型 → 回答文字

相較之下,OpenClaw 這類 Agent 型系統,則逐漸轉變為:

使用者 → 語言模型 → 任務拆解 → 工具操作 → 回饋 → 再決策

這意味著,AI 不再只是輸出文字,而是進入**迴圈式決策與執行(closed-loop execution)**的運作模式,例如:

- 能判斷下一步應採取的行動

- 能嘗試操作各類工具或系統介面

- 能根據執行結果動態修正策略

- 能持續推進流程,直到完成指定任務

從資料科學的觀點來看,這樣的系統更接近一種自動化決策與執行系統,而不僅僅是具備對話能力的介面。

因此,將 ChatGPT 類工具比喻為「實習生」,而將 Agent 型 AI 視為「可獨立跑流程的員工」,在概念上其實相當貼切。

3. 產業視角:真正的價值不在炫技,而在「替代流程成本」

從產業應用的角度來看,評估這類工具的價值,至少可聚焦於三個問題:

(1)能否穩定重現?

(2)能否實質節省人力時間?

(3)能否被整合進既有流程?

若系統僅止於技術展示,在實務上卻出現:

- 操作結果不穩定

- 介面稍有變動即失效

- 無法納入既有 SOP

那麼其產業價值將相當有限。

反之,若能實際應用於:

- 協助業務自動整理 CRM

- 協助營運部門產出報表並回填系統

- 協助行銷進行跨平台上稿與檢核

- 協助工程團隊執行例行部署與測試流程

其影響將不僅是個別員工效率的提升,而是整體白領工作流程成本結構的改變。

4. 現實面的冷靜提醒:Agent 不等於萬能

即便如此,從務實角度出發,這類系統仍面臨數個關鍵挑戰:

- 穩定性問題:介面變動、權限限制與例外情境仍是主要風險來源

- 可控性問題:組織能在多大程度上信任 AI 自主操作系統?

- 責任歸屬問題:當自動化執行出錯時,責任應如何界定?

這些問題並非僅靠模型能力提升即可解決,而涉及組織治理、資訊安全與流程設計等層面。因此,短期內更合理的定位,或許是將 OpenClaw 視為「高潛力的數位助理」,而非可全面取代人力的自動員工。

5. 結語:真正的轉折點,是 AI 開始「進入流程」

如果說過去兩年是 AI 進入內容生產階段,那麼接下來幾年,很可能是 AI 進入企業流程與操作層 的階段。

OpenClaw 類工具的意義,不僅在於目前能完成多少任務,而在於它揭示了一個方向:

AI 不再只是提供建議,而是開始參與實際執行。

這一步,將可能深刻影響組織運作方式、生產力模型,以及人類在工作流程中所扮演的角色。而我們現在所看到的,或許只是這條路徑的第一個可行版本。